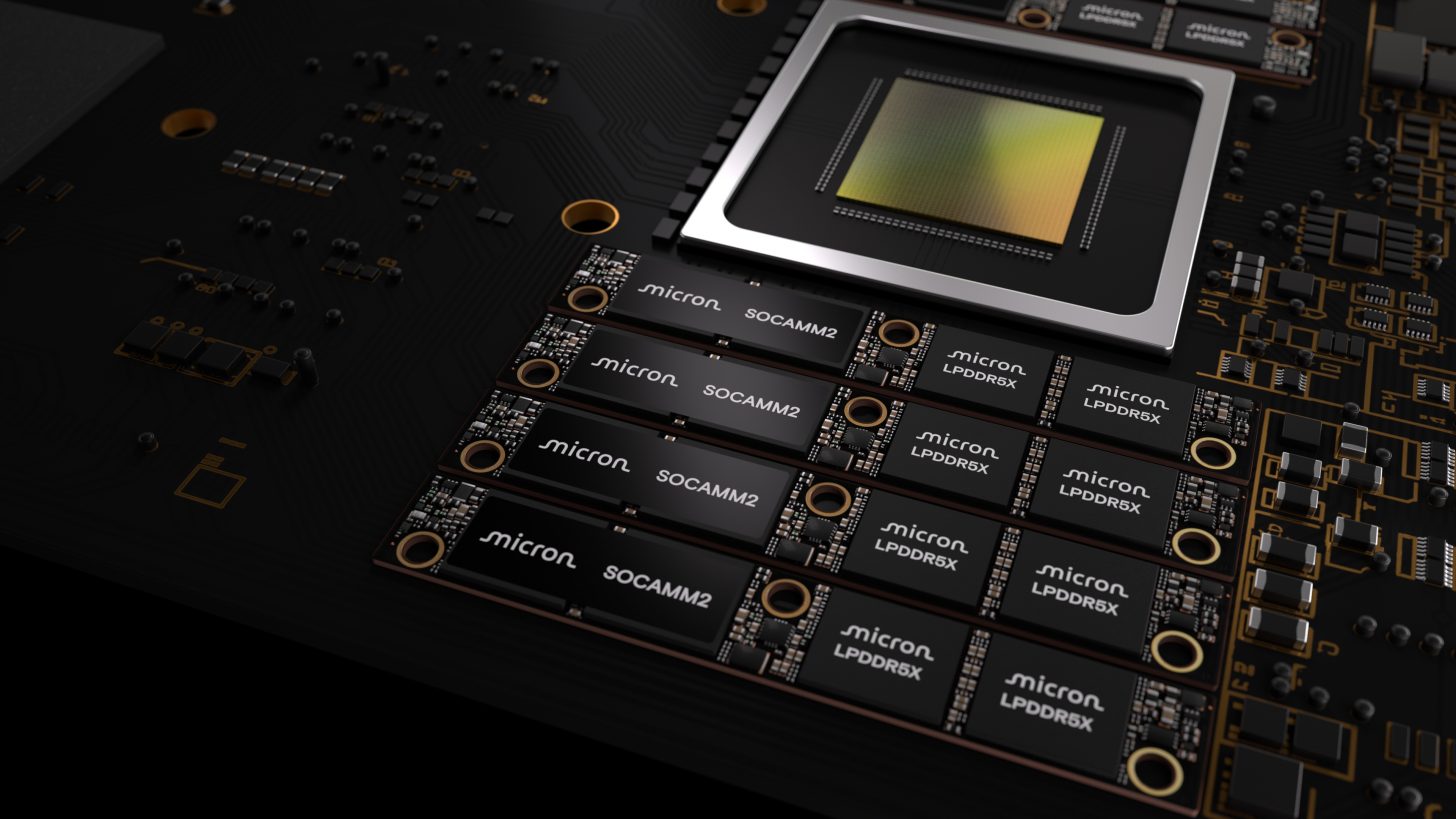

Micron ประกาศเปิดตัวโมดูลหน่วยความจำ SOCAMM2 ขนาด 256GB ซึ่งบริษัทระบุว่าเป็น โมดูล SOCAMM2 ตัวแรกของโลกที่มีความจุระดับนี้ โดยถูกออกแบบมาเพื่อรองรับความต้องการของระบบ Agentic AI และงาน inference ที่ต้องใช้หน่วยความจำจำนวนมาก

โมดูลใหม่นี้ถูกพัฒนาร่วมกับ NVIDIA และมีแนวโน้มว่าจะถูกนำไปใช้ในระบบ AI รุ่นใหม่อย่าง Vera Rubin

SOCAMM2 คืออะไร

SOCAMM (System On Chip Advanced Memory Module) เป็นมาตรฐานหน่วยความจำสำหรับเซิร์ฟเวอร์ AI ที่ใช้ LPDRAM

จุดเด่นของมาตรฐานนี้คือ

ประหยัดพลังงานกว่า DRAM เซิร์ฟเวอร์ทั่วไป

มีความหนาแน่นของหน่วยความจำสูง

รองรับงาน AI inference ที่ต้องใช้ context ขนาดใหญ่

SOCAMM2 เป็นรุ่นพัฒนาต่อจาก SOCAMM รุ่นแรก โดยเพิ่มทั้ง

ความจุ

ประสิทธิภาพ

ประสิทธิภาพต่อวัตต์

ความจุ 256GB ต่อโมดูล

โมดูล SOCAMM2 ใหม่ของ Micron มีความจุ 256GB ต่อโมดูล

เพิ่มขึ้นจากมาตรฐานก่อนหน้าที่อยู่ที่ 192GB

Micron ยังได้เพิ่มความจุของ LPDRAM die เดี่ยวเป็น 32GB

เมื่อใช้งานร่วมกับระบบ CPU ที่มี 8 memory channels

จะสามารถรองรับหน่วยความจำรวมได้ถึง

2TB LPDRAM ต่อ CPU

ซึ่งเป็นระดับที่เหมาะกับระบบ AI ขนาดใหญ่

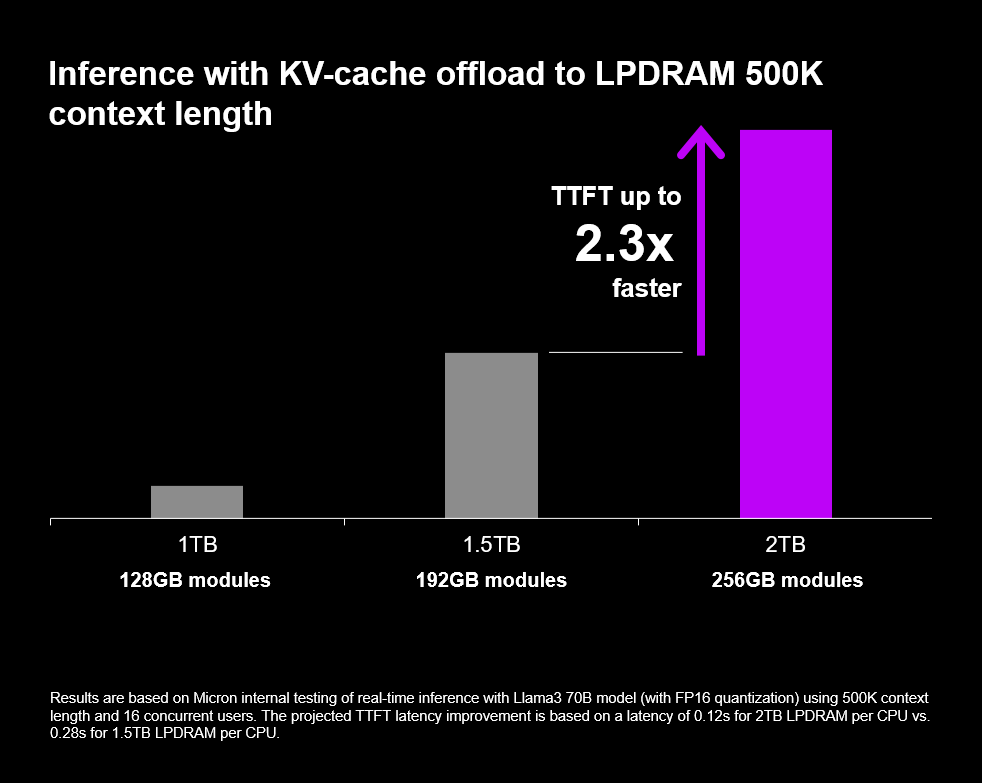

ช่วยแก้ปัญหา KV-Cache ใน AI

หนึ่งในปัญหาใหญ่ของระบบ AI รุ่นใหม่คือ memory bottleneck

โดยเฉพาะในงาน inference ที่ต้องใช้ KV-cache

เช่น

LLM context window ขนาดใหญ่

AI agent หลายตัวทำงานร่วมกัน

reasoning ที่ต้องเก็บข้อมูลจำนวนมาก

SOCAMM2 ถูกออกแบบมาเพื่อช่วยแก้ปัญหานี้

Micron ระบุว่า

Time to First Token (TTFT) สำหรับ inference context ยาวสามารถเพิ่มขึ้นได้ 2.3 เท่า

ซึ่งช่วยลด latency ของ AI ได้อย่างมาก

พัฒนาโดยร่วมมือกับ NVIDIA

SOCAMM2 ถูกพัฒนาร่วมกับ NVIDIA และถูกวางแผนให้ใช้กับ

แพลตฟอร์ม AI รุ่น Vera Rubin

NVIDIA ระบุว่าหน่วยความจำประเภทนี้ช่วยให้

AI CPU รุ่นใหม่ทำงานได้เต็มประสิทธิภาพ

ลดการใช้พลังงานของเซิร์ฟเวอร์

เพิ่ม bandwidth ต่อระบบ

DRAM อาจตึงตัวมากขึ้น

แม้ SOCAMM2 จะช่วยเพิ่มประสิทธิภาพ AI แต่ก็มีผลกระทบต่อตลาดหน่วยความจำ

เพราะโมดูลเหล่านี้จะใช้ DRAM จำนวนมาก

ซึ่งอาจทำให้

DRAM สำหรับผู้บริโภคมีน้อยลง

GDDR7 สำหรับ GPU ถูกแย่ง supply

ราคาหน่วยความจำสูงขึ้น

ตลาดหน่วยความจำในปี 2026 จึงมีแนวโน้มตึงตัวจากความต้องการของ AI

เริ่มส่งตัวอย่างให้ลูกค้าแล้ว

Micron ระบุว่า

โมดูล SOCAMM2 256GB ได้เริ่มส่งตัวอย่างให้ลูกค้าแล้ว

และจะถูกนำไปโชว์อย่างเป็นทางการในงาน

NVIDIA GTC 2026

ซึ่งคาดว่าจะเป็นเวทีเปิดตัวระบบ AI รุ่นใหม่จำนวนมาก

บทสรุป

SOCAMM2 256GB ของ Micron เป็นก้าวสำคัญของหน่วยความจำสำหรับยุค AI

จุดเด่นหลัก

โมดูล SOCAMM2 ตัวแรกที่มีความจุ 256GB

รองรับ 2TB ต่อ CPU ในระบบ 8-channel

ลด latency ของ AI inference

พัฒนาร่วมกับ NVIDIA สำหรับระบบ Vera Rubin

แต่ในอีกด้านหนึ่ง ความต้องการหน่วยความจำจาก AI ที่เพิ่มขึ้นอย่างรวดเร็ว อาจทำให้ตลาด DRAM และ NAND สำหรับผู้บริโภคตึงตัวมากขึ้นในอนาคต