AMD เดินหน้าชน NVIDIA ในตลาด AI และ HPC

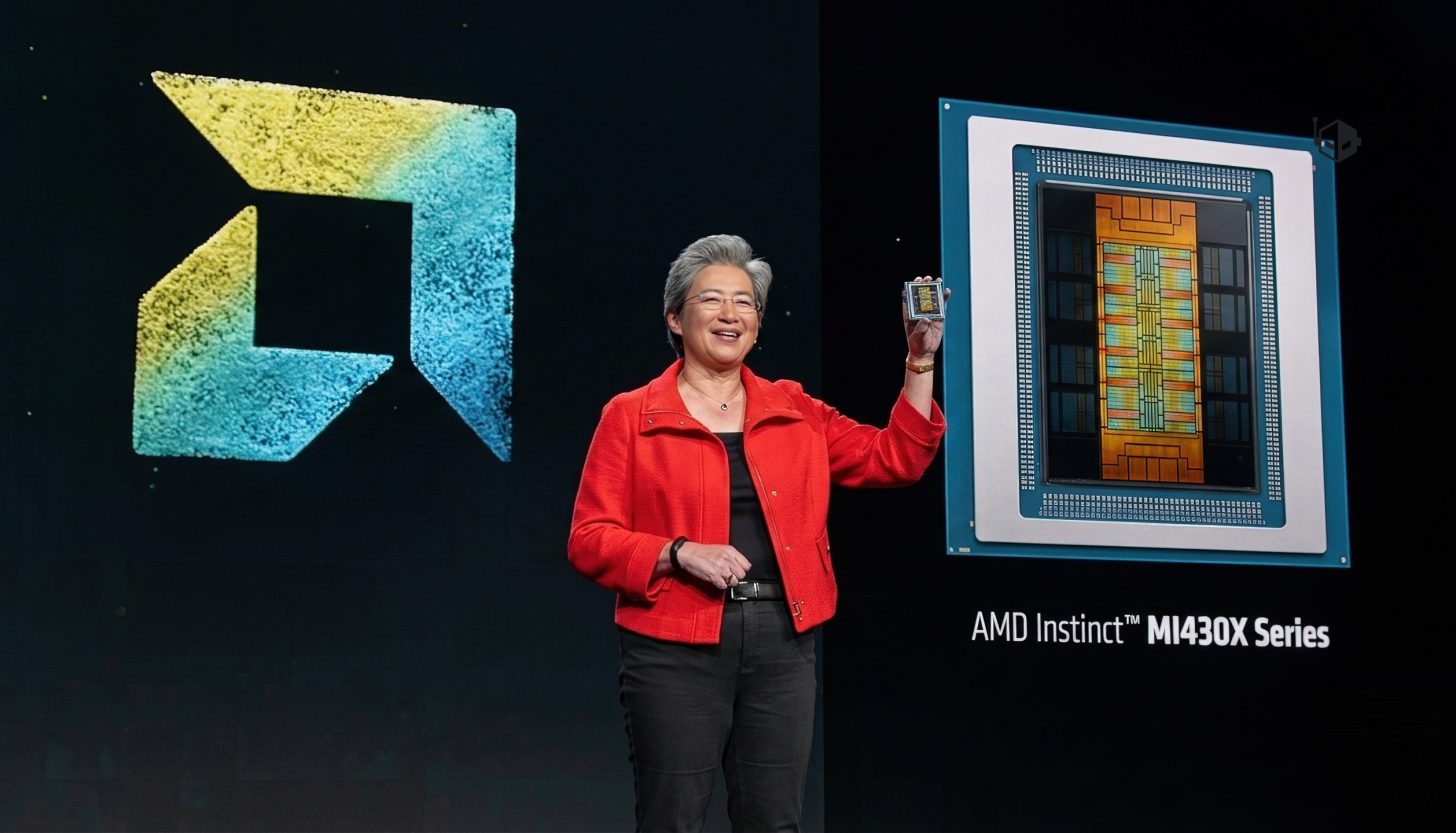

AMD เริ่มเปิดเผยรายละเอียดเพิ่มเติมของ Instinct MI430X GPU รุ่นใหม่ ที่ถูกวางให้เป็นอาวุธหลักสำหรับตลาด AI และ High Performance Computing หรือ HPC ในช่วงปี 2026–2028

จุดที่ถูกพูดถึงมากที่สุดคือ AMD ระบุว่า MI430X จะมีประสิทธิภาพด้าน FP64 หรือ double-precision floating point สูงกว่า NVIDIA Rubin ได้สูงสุดถึงประมาณ 6 เท่า

ประเด็นนี้กลายเป็นข่าวใหญ่ทันที เพราะช่วงหลัง NVIDIA เริ่มโฟกัส GPU สำหรับ AI inference และ low-precision AI workload อย่าง FP4 และ FP8 มากขึ้น ขณะที่ AMD เลือกเดินอีกทางด้วยการเพิ่ม “native FP64 performance” สำหรับงานวิทยาศาสตร์และซูเปอร์คอมพิวเตอร์โดยเฉพาะ

FP64 คืออะไร และทำไม AMD ถึงเน้นหนัก

FP64 หรือ double-precision floating point เป็นรูปแบบการคำนวณที่ใช้ในงาน

วิทยาศาสตร์

climate simulation

ฟิสิกส์

การคำนวณโมเดลระดับประเทศ

และ HPC ระดับ exascale

แม้ GPU ยุค AI ส่วนใหญ่จะเน้น FP4, FP8 หรือ FP16 เพื่อเร่งความเร็ว AI training แต่หลายงานด้านวิทยาศาสตร์ยังต้องการ FP64 แบบ native เพราะความแม่นยำมีความสำคัญสูงมาก

AMD มองว่าตลาด AI for Science กำลังโตขึ้น และงานประเภทนี้ยังไม่สามารถพึ่ง low-precision AI เพียงอย่างเดียวได้

Nick Malaya จาก AMD ระบุว่า FP64 ยัง “สำคัญมาก” สำหรับระบบ AI และ simulation รุ่นใหม่ โดยเฉพาะในงานระดับ national laboratory

AMD บอกว่า Rubin พึ่ง Ozaki มากเกินไป

รายงานจาก HPCWire ระบุว่า AMD ไม่เห็นด้วยกับแนวทางของ NVIDIA ที่ใช้เทคนิค Ozaki emulation เพื่อเพิ่มประสิทธิภาพ FP64 บน Blackwell และ Rubin แทนการเพิ่ม FP64 hardware โดยตรง

NVIDIA มองว่างานส่วนใหญ่ติด bottleneck ที่

memory bandwidth

cache

และ interconnect

มากกว่าพลัง FP64 ดิบ

แต่ AMD มองตรงกันข้าม โดยเชื่อว่าการเพิ่ม bandwidth เพียงอย่างเดียวไม่พอ และ GPU สำหรับ HPC ควรเพิ่มทั้ง

HBM bandwidth

และ native FP64 compute

ไปพร้อมกัน

AMD ยังระบุว่า MI430X จะรักษา “byte-to-flop ratio” ให้สมดุลกว่า Rubin ซึ่งเป็นแนวคิดสำคัญของงาน HPC ระดับสูง

MI430X มาพร้อม HBM4 ขนาด 432GB

อีกจุดที่ทำให้ MI430X ถูกพูดถึงมากคือสเปกด้าน memory ที่ใหญ่มาก

AMD ยืนยันแล้วว่า MI430X จะใช้

HBM4 ขนาด 432GB

bandwidth สูงถึง 19.6TB/s

ซึ่งมากกว่า MI355 รุ่นปัจจุบันแบบก้าวกระโดด และยังมากกว่า NVIDIA Rubin ในบางด้านด้วย

AMD มองว่าความจุ HBM จำนวนมหาศาลจะช่วยลด bottleneck ในงาน AI และ simulation ได้ดีขึ้น

โดยเฉพาะโมเดลขนาดใหญ่ที่ต้องใช้ memory footprint สูงมาก

หลายฝ่ายมองว่า MI430X กำลังพยายามแข่งกับ NVIDIA ใน “system-level AI” มากกว่าแข่งแค่ FLOPS แบบเดิม

AMD อาจดัน FP64 ไปแตะระดับ 200 TFLOPS

แม้ AMD ยังไม่เปิดตัวเลข FP64 อย่างเป็นทางการ แต่หลายสำนักคาดว่า MI430X อาจมี native FP64 performance สูงถึงประมาณ 192–204 TFLOPS

หากตัวเลขนี้ถูกต้องจริง จะสูงกว่า Rubin ที่ NVIDIA คาดว่าจะมี FP64 native ประมาณ 33 TFLOPS อย่างชัดเจน

และแม้ NVIDIA จะใช้ Ozaki emulation เพื่อเพิ่ม effective FP64 throughput ขึ้นไปประมาณ 200 TFLOPS แต่ AMD มองว่าการใช้ native FP64 จริงยังสำคัญกว่าในงาน HPC จำนวนมาก

นี่จึงเป็นที่มาของคำกล่าวอ้างว่า MI430X อาจแรงกว่า Rubin ด้าน FP64 ได้สูงสุดประมาณ 6 เท่าในบาง workload

Discovery Supercomputer จะใช้ MI430X

AMD ยังประกาศแล้วว่า MI430X จะถูกใช้ใน Discovery supercomputer ของ Oak Ridge National Laboratory ในสหรัฐ

ระบบดังกล่าวจะมาแทน Frontier และถูกวางให้เป็นหนึ่งใน AI Factory supercomputer รุ่นแรกของสหรัฐ

Discovery จะใช้

AMD Instinct MI430X

EPYC Venice CPU

และ HPE Cray GX5000 platform

เพื่อรองรับทั้ง

AI training

large-scale simulation

และ scientific computing

พร้อมกันบนระบบเดียว

AMD ยังระบุว่า MI430X ถูกออกแบบมาให้รองรับ “AI + HPC convergence” โดยเฉพาะ ซึ่งเป็นแนวคิดที่เริ่มได้รับความสำคัญมากขึ้นในวงการซูเปอร์คอมพิวเตอร์ยุคใหม่

AMD เริ่มแบ่ง GPU สำหรับ AI กับ HPC ชัดเจน

ข้อมูลล่าสุดยังระบุว่า AMD เริ่มแยกสายผลิตภัณฑ์ AI accelerator ชัดเจนมากขึ้น

โดย

MI430X จะเน้น HPC และ FP64

ส่วน MI455X จะเน้น AI training และ inference ขนาดใหญ่

หลายฝ่ายมองว่านี่คือกลยุทธ์ใหม่ของ AMD ที่ไม่พยายามทำ GPU “สารพัดอย่าง” แบบเดียว แต่แยกตาม workload จริงของตลาด

โดยเฉพาะตลาด HPC ที่ยังให้ความสำคัญกับ FP64 และ numerical accuracy สูงมาก

AMD กำลังพยายามสร้างจุดต่างจาก NVIDIA

ในช่วงหลายปีที่ผ่านมา NVIDIA ครองตลาด AI accelerator อย่างชัดเจน ทั้งในด้าน

ecosystem

CUDA

networking

และ AI software stack

AMD จึงพยายามสร้างจุดต่างด้วย

memory capacity ที่สูงกว่า

HBM bandwidth ที่มากกว่า

และ native FP64 ที่แรงกว่า

หลายฝ่ายมองว่า AMD กำลังพยายามวางตำแหน่ง MI430X ให้เป็น GPU สำหรับ “AI + Science” มากกว่า AI อย่างเดียว

โดยเฉพาะในตลาด national lab, government AI infrastructure และ exascale supercomputer

สรุปภาพรวม AMD MI430X

AMD เริ่มเปิดเผยรายละเอียดของ Instinct MI430X GPU รุ่นใหม่ ที่ถูกออกแบบมาสำหรับงาน AI และ HPC ระดับสูง

จุดเด่นสำคัญคือ

native FP64 performance ระดับสูง

HBM4 ขนาด 432GB

bandwidth 19.6TB/s

และการรองรับทั้ง AI กับ scientific computing บนระบบเดียว

AMD ยังระบุว่า MI430X จะมีประสิทธิภาพ FP64 สูงกว่า NVIDIA Rubin ได้สูงสุดประมาณ 6 เท่าในบาง workload และจะกลายเป็นหัวใจสำคัญของ Discovery supercomputer รุ่นใหม่ของสหรัฐ

การเปิดตัวครั้งนี้สะท้อนชัดว่า AMD ไม่ได้พยายามแข่งกับ NVIDIA แค่ด้าน AI inference อีกต่อไป แต่กำลังรุกหนักในตลาด AI + HPC convergence ที่เริ่มกลายเป็นสนามแข่งขันสำคัญของวงการ GPU ยุคใหม่

ที่มา wccftech

ความคิดเห็น