NVIDIA เดินเกมรุกหนักในปีนี้ โดยหนึ่งในดีลที่ใหญ่ที่สุดคือความร่วมมือกับ Groq มูลค่าสูงสุดถึง 20,000 ล้านดอลลาร์ ซึ่งถือเป็นการลงทุนครั้งใหญ่ที่สุดของบริษัทในช่วงหลัง แม้ประกาศจะออกมาเงียบ ๆ ช่วงคริสต์มาสอีฟ แต่รายละเอียดแผนการใช้งานจริงยังไม่ถูกเปิดเผยชัดเจน

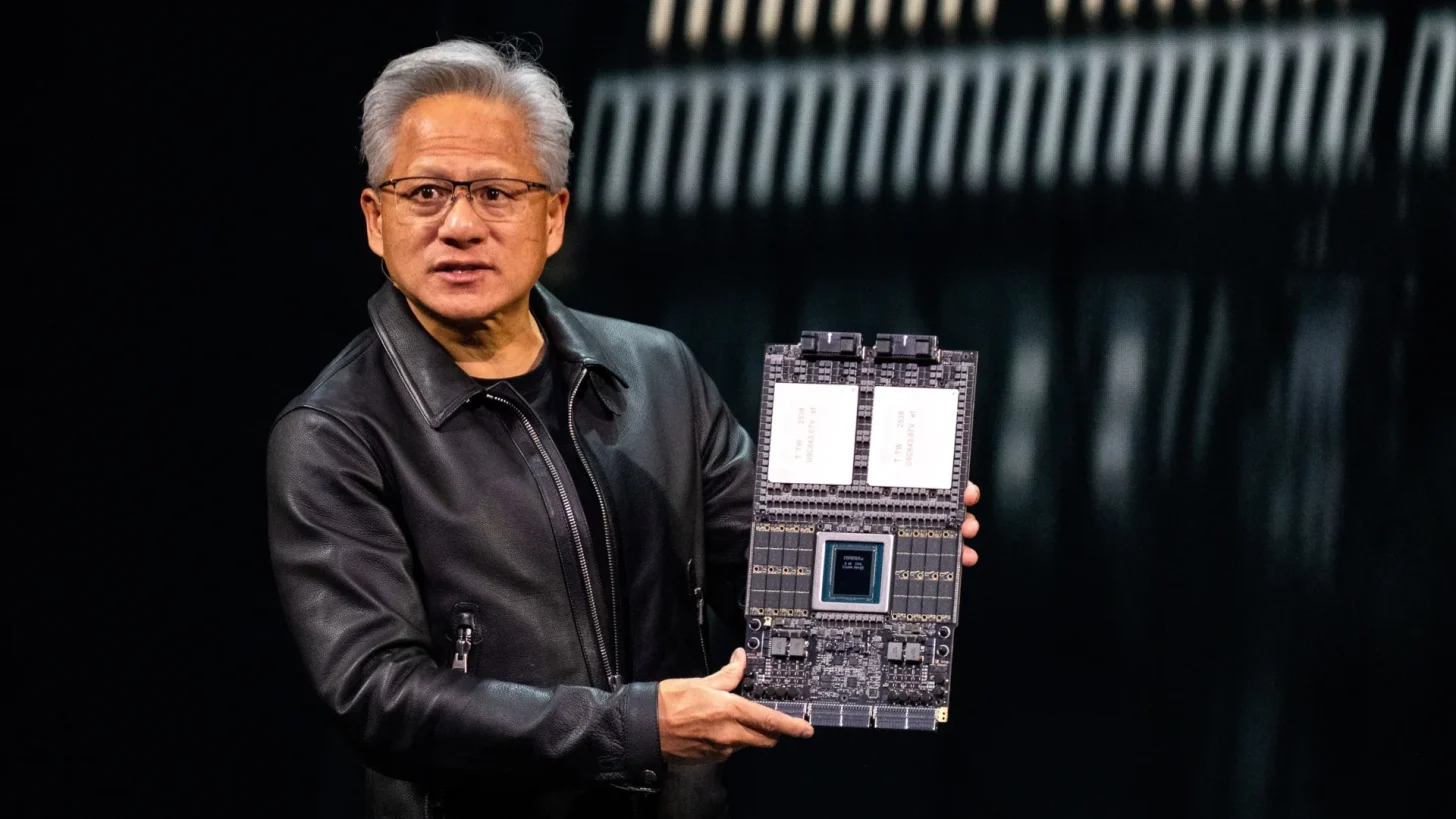

ล่าสุดในช่วงรายงานผลประกอบการไตรมาส 4 ปีงบประมาณ 2026 Jensen Huang ซีอีโอของ NVIDIA ถูกถามตรง ๆ ว่าบริษัทจะทำอะไรกับ Groq และ LPU (Language Processing Unit) คำตอบของเขาน่าสนใจไม่น้อย เพราะเขาเปรียบเทียบดีลนี้กับการซื้อ Mellanox ในอดีต พร้อมบอกว่าจะ “ขยายสถาปัตยกรรมของ NVIDIA ด้วย Groq ในฐานะ accelerator”

คำพูดสั้น ๆ นี้กำลังจุดประเด็นถกเถียงในวงการว่า NVIDIA กำลังวางหมากอะไรในตลาด AI โดยเฉพาะงานที่ต้องการความหน่วงต่ำ (low-latency workloads)

Groq คือใคร และ LPU คืออะไร

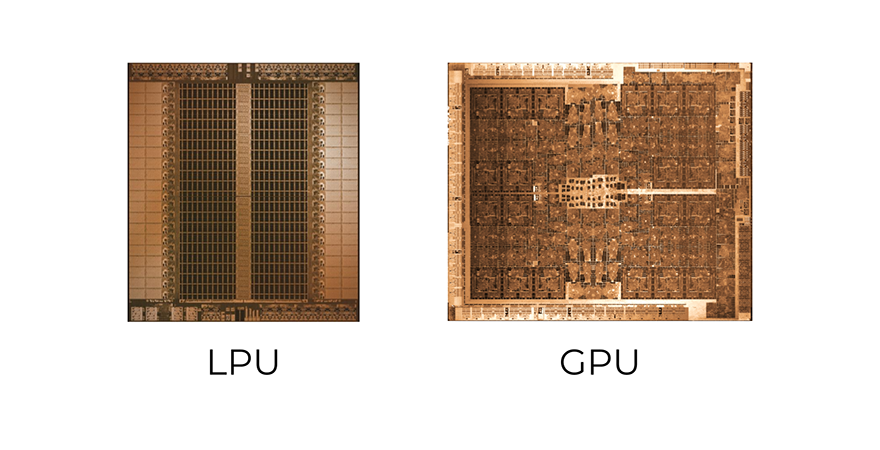

Groq เป็นบริษัทที่พัฒนา LPU หรือ Language Processing Unit ซึ่งออกแบบมาเน้นประสิทธิภาพในงาน inference โดยเฉพาะขั้นตอนที่เรียกว่า “decode”

ในโลกของ AI โดยเฉพาะ Large Language Models (LLMs) การทำงานหลักแบ่งเป็นสองช่วงสำคัญ:

Prefill: ขั้นตอนประมวลผลข้อมูลตั้งต้น เช่น การอ่าน prompt ยาว ๆ

Decode: ขั้นตอนสร้างคำตอบทีละโทเคน ซึ่งเกิดขึ้นต่อเนื่องและไวต่อความหน่วง

ในยุคที่แอปพลิเคชัน AI ต้องตอบสนองแบบเรียลไทม์ เช่น AI agent หลายตัวทำงานร่วมกัน (agentic AI) ความหน่วงในขั้น decode กลายเป็นคอขวดสำคัญ

LPU ของ Groq ใช้ SRAM บนชิป (on-die SRAM) เพื่อให้แบนด์วิดท์ภายในระดับหลายสิบเทราไบต์ต่อวินาที ทำให้เหมาะกับงานที่ต้องการ latency ต่ำมาก

ทำไม NVIDIA ถึงต้องการ Groq

ที่ผ่านมา NVIDIA ครองตลาด “การเทรนโมเดล” อย่างชัดเจน ด้วยสถาปัตยกรรมอย่าง Hopper และ Blackwell

แต่เมื่ออุตสาหกรรมเริ่มขยับจาก training ไปสู่ inference ในระดับใช้งานจริง (production scale) การแข่งขันเริ่มเข้มข้นขึ้น

ในฝั่ง inference:

งาน prefill ถูกเร่งด้วยสถาปัตยกรรมใหม่อย่าง Rubin CPX

NVIDIA ใช้ attention-acceleration engines และ NVFP4 compute เพิ่มประสิทธิภาพ

แต่ในส่วน decode ซึ่งสำคัญมากสำหรับ agentic AI และระบบหลายเอเจนต์ NVIDIA ยังต้องเสริมจุดแข็ง

Groq และ LPU จึงเข้ามาเติมเต็มช่องว่างนี้

เปรียบเทียบกับ Mellanox ทำไมสำคัญ

Jensen Huang บอกชัดว่า บทบาทของ Groq จะคล้ายกับ Mellanox

ย้อนกลับไปปี 2019 NVIDIA เข้าซื้อ Mellanox ซึ่งเป็นบริษัทด้านเครือข่ายความเร็วสูง และเป็นรากฐานของ InfiniBand ในดาต้าเซ็นเตอร์

ดีลนั้นช่วยแก้ “ปัญหาเครือข่าย” และนำไปสู่แนวคิดที่ NVIDIA เรียกว่า extreme co-design คือการออกแบบ GPU, networking และระบบรวมกันทั้งสแต็ก

ผลลัพธ์คือ NVIDIA ครองตลาด AI datacenter อย่างเต็มตัว

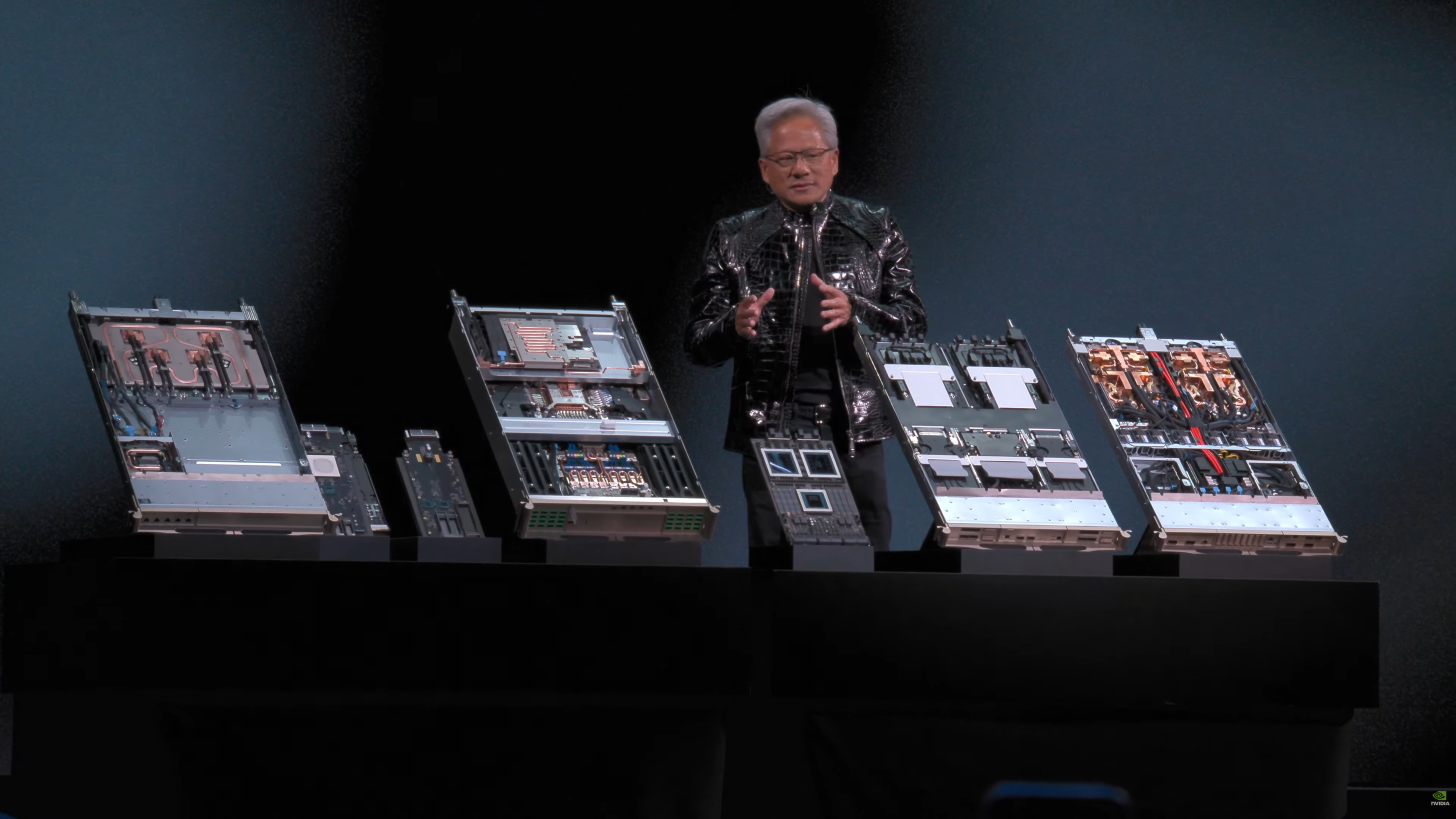

ถ้า Groq จะเล่นบทเดียวกัน นั่นหมายความว่า NVIDIA อาจกำลังสร้าง “สถาปัตยกรรมไฮบริด” ที่รวม GPU + LPU เข้าด้วยกันในระดับแร็ก (rack-scale integration)

NVIDIA จะเอา LPU ไปวางตรงไหน

ตอนนี้มีสองแนวคิดหลักในอุตสาหกรรม:

1. Rack-Scale Integration

แนวคิดแรกคือ NVIDIA อาจเปิดตัว “LPX rack” ในงาน GTC ปีนี้ โดยมี LPU มากถึง 256 ตัวในหนึ่งแร็ก

โครงสร้างอาจเป็น:

LPU เชื่อมต่อกันผ่านโปรโตคอล chip-to-chip

เชื่อมกับ GPU ผ่าน NVLink Fusion

รองรับการถ่ายโอน KV cache ปริมาณมหาศาลจาก GPU ไปยัง LPU ในขั้น decode

แนวทางนี้ดูมีความเป็นไปได้สูง เพราะสอดคล้องกับโมเดล datacenter ของ NVIDIA ปัจจุบัน

2. รวม LPU เข้าไปใน GPU โดยตรง

อีกแนวคิดคือการฝัง LPU เข้าไปใน GPU รุ่นอนาคต เช่น Feynman ผ่านเทคโนโลยี hybrid bonding

แม้ฟังดูน่าสนใจ แต่ในระยะสั้น แนว rack-scale ดูเป็นไปได้มากกว่า

ทำไม latency ถึงสำคัญมากในยุค AI agent

ในระบบ agentic AI ที่หลายโมเดลสื่อสารและตัดสินใจร่วมกัน การตอบสนองต้องเร็วระดับวินาทีหรือน้อยกว่า

ขั้น decode คือช่วงที่โมเดล “คิดและตอบ” แบบโต้ตอบ

หาก decode ช้า:

การโต้ตอบหลายเอเจนต์จะสะดุด

ระบบเรียลไทม์ เช่น ผู้ช่วยอัตโนมัติ หรือ AI swarm จะไม่มีประสิทธิภาพ

NVIDIA มองเห็นว่าโลกกำลังมุ่งสู่ AI หลายตัวทำงานร่วมกัน (AI swarms) ซึ่งต้องการ latency ต่ำกว่าที่เคย

Groq LPU จึงกลายเป็นชิ้นส่วนสำคัญในเกมนี้

สัญญาณจากผลประกอบการ

Jensen ยังเปิดเผยว่า ปัจจุบันการเติบโตของ compute และรายได้กำลังโตแบบ 1:1 ซึ่งขับเคลื่อนโดย “application layer” ของ AI ที่พัฒนาเร็วมาก

นั่นหมายความว่า ความต้องการประมวลผลในระดับใช้งานจริงกำลังเพิ่มขึ้น ไม่ใช่แค่การเทรนโมเดลในแล็บ

การมี accelerator สำหรับ decode จะทำให้ NVIDIA แข็งแกร่งขึ้นในตลาด inference ซึ่งกำลังเป็นสนามรบใหม่

บทสรุป: Groq อาจเป็นหมากสำคัญของ NVIDIA ในยุค AI ใหม่

การที่ NVIDIA เปรียบ Groq กับ Mellanox ไม่ใช่คำพูดเล่น ๆ เพราะ Mellanox คือดีลที่เปลี่ยนเกมดาต้าเซ็นเตอร์ของบริษัท

ถ้า LPU ของ Groq ถูกผสานเข้ากับสถาปัตยกรรม NVIDIA ในระดับแร็กจริง จะทำให้บริษัทครอบคลุมทั้ง:

Training (Hopper, Blackwell, Rubin)

Prefill acceleration

Decode acceleration

ครบทั้งวงจร inference

รายละเอียดทั้งหมดน่าจะถูกเปิดเผยชัดเจนขึ้นในงาน GTC ปีนี้

แต่จากสิ่งที่ Jensen ส่งสัญญาณออกมา ดูเหมือน NVIDIA กำลังเตรียมวางหมากใหญ่ เพื่อครองตลาด AI ที่ต้องการความหน่วงต่ำ ก่อนคู่แข่งจะตามทัน