งาน NVIDIA GTC 2026 กำลังถูกจับตามองอย่างมากในวงการเทคโนโลยี โดยเฉพาะในกลุ่มผู้พัฒนา AI และผู้ให้บริการโครงสร้างพื้นฐานด้านคอมพิวต์ เนื่องจากมีสัญญาณว่าบริษัทอาจกำลังปรับแนวคิดด้านสถาปัตยกรรมการประมวลผลครั้งใหญ่

ที่ผ่านมา NVIDIA มีแนวคิดสำคัญคือการใช้ GPU เป็นศูนย์กลางของระบบคอมพิวต์สำหรับ AI แต่ด้วยความต้องการด้านการประมวลผลที่เปลี่ยนไป โดยเฉพาะงาน AI รุ่นใหม่ที่ซับซ้อนมากขึ้น บริษัทอาจเริ่มเปลี่ยนไปสู่แพลตฟอร์มที่ใช้ฮาร์ดแวร์หลายประเภททำงานร่วมกัน

การประกาศในงานปีนี้จึงอาจสะท้อนการเปลี่ยนแปลงครั้งสำคัญของอุตสาหกรรม AI infrastructure

ทำไม NVIDIA อาจต้องเปลี่ยนแนวคิด GPU-Only

ในช่วงหลายปีที่ผ่านมา GPU กลายเป็นหัวใจหลักของการพัฒนา AI โดยเฉพาะการฝึกโมเดลขนาดใหญ่ เช่น Large Language Models

สถาปัตยกรรมอย่าง

Hopper

Blackwell

ถูกออกแบบมาเพื่อรองรับงานฝึกโมเดล (AI training) ที่ต้องใช้พลังประมวลผลจำนวนมหาศาล

อย่างไรก็ตาม เมื่อเข้าสู่ปี 2026 แนวโน้มของงาน AI เริ่มเปลี่ยนไปสู่สิ่งที่เรียกว่า Agentic Workloads ซึ่งหมายถึงระบบ AI ที่ทำงานแบบอัตโนมัติและต้องตอบสนองแบบเรียลไทม์

งานลักษณะนี้ทำให้ความต้องการด้านการประมวลผลเปลี่ยนจาก

การฝึกโมเดลขนาดใหญ่

ไปสู่การประมวลผล inference ที่รวดเร็วและมีประสิทธิภาพ

ความร่วมมือระหว่าง NVIDIA และ Groq

หนึ่งในประเด็นที่ถูกจับตามองใน NVIDIA GTC 2026 คือความร่วมมือกับบริษัท Groq

Groq เป็นผู้พัฒนาชิปประมวลผลที่เรียกว่า LPU (Language Processing Unit) ซึ่งถูกออกแบบมาเพื่อเพิ่มประสิทธิภาพในการประมวลผล AI inference โดยเฉพาะ

มีรายงานว่า NVIDIA อาจนำ LPU มาใช้ร่วมกับระบบ Vera Rubin ซึ่งเป็นแพลตฟอร์ม AI รุ่นใหม่ของบริษัท

แนวคิดนี้จะทำให้ระบบคอมพิวต์ไม่พึ่ง GPU เพียงอย่างเดียว แต่ใช้ฮาร์ดแวร์หลายประเภทเพื่อแบ่งงานกันประมวลผล

ตัวอย่างเช่น

GPU สำหรับการประมวลผลหลัก

LPU สำหรับขั้นตอน inference และ decoding

การผสานการทำงานของชิปหลายประเภทนี้อาจเชื่อมต่อผ่านเทคโนโลยี NVLink Fusion เพื่อเพิ่มประสิทธิภาพการส่งข้อมูลระหว่างอุปกรณ์

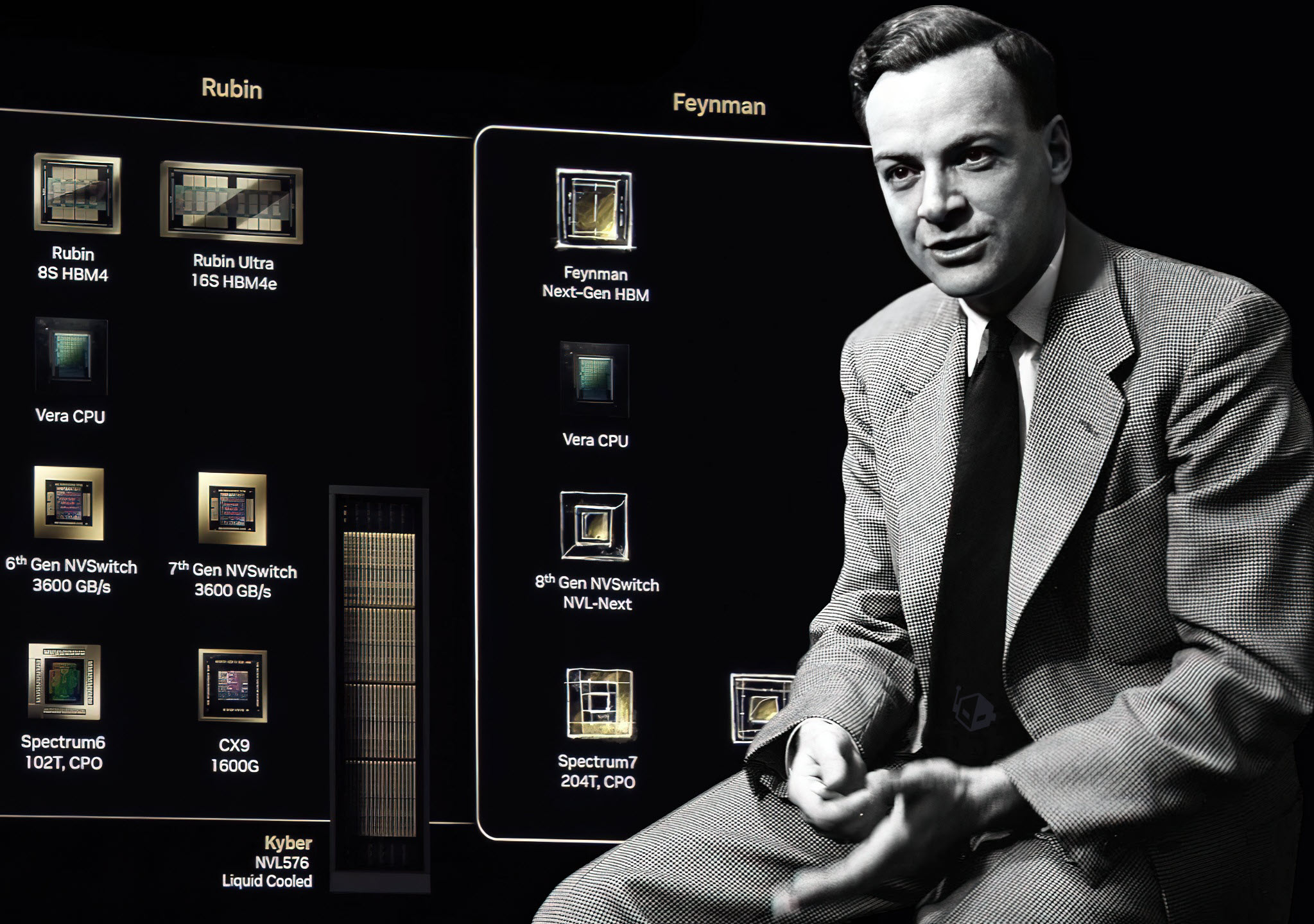

สถาปัตยกรรม AI รุ่นใหม่ Feynman

นอกจาก Vera Rubin แล้ว NVIDIA ยังถูกคาดว่าจะเปิดเผยข้อมูลเพิ่มเติมเกี่ยวกับ Feynman ซึ่งเป็นสถาปัตยกรรม AI รุ่นถัดไป

Feynman ถูกคาดว่าจะใช้กระบวนการผลิตระดับ TSMC A16 หรือประมาณ 1.6 นาโนเมตร ซึ่งถือเป็นเทคโนโลยีการผลิตที่ล้ำหน้ามาก

นอกจากนี้ยังมีข่าวลือเกี่ยวกับการใช้เทคโนโลยี

3D stacking

hybrid bonding

chiplet architecture

เทคโนโลยีเหล่านี้ช่วยให้สามารถเพิ่มจำนวนทรานซิสเตอร์และประสิทธิภาพของชิปได้มากขึ้น โดยไม่ต้องเพิ่มขนาดของตัวชิปมากนัก

บางรายงานยังระบุว่า LPU อาจถูกนำมารวมเข้ากับโครงสร้างของชิปรุ่นนี้ด้วย

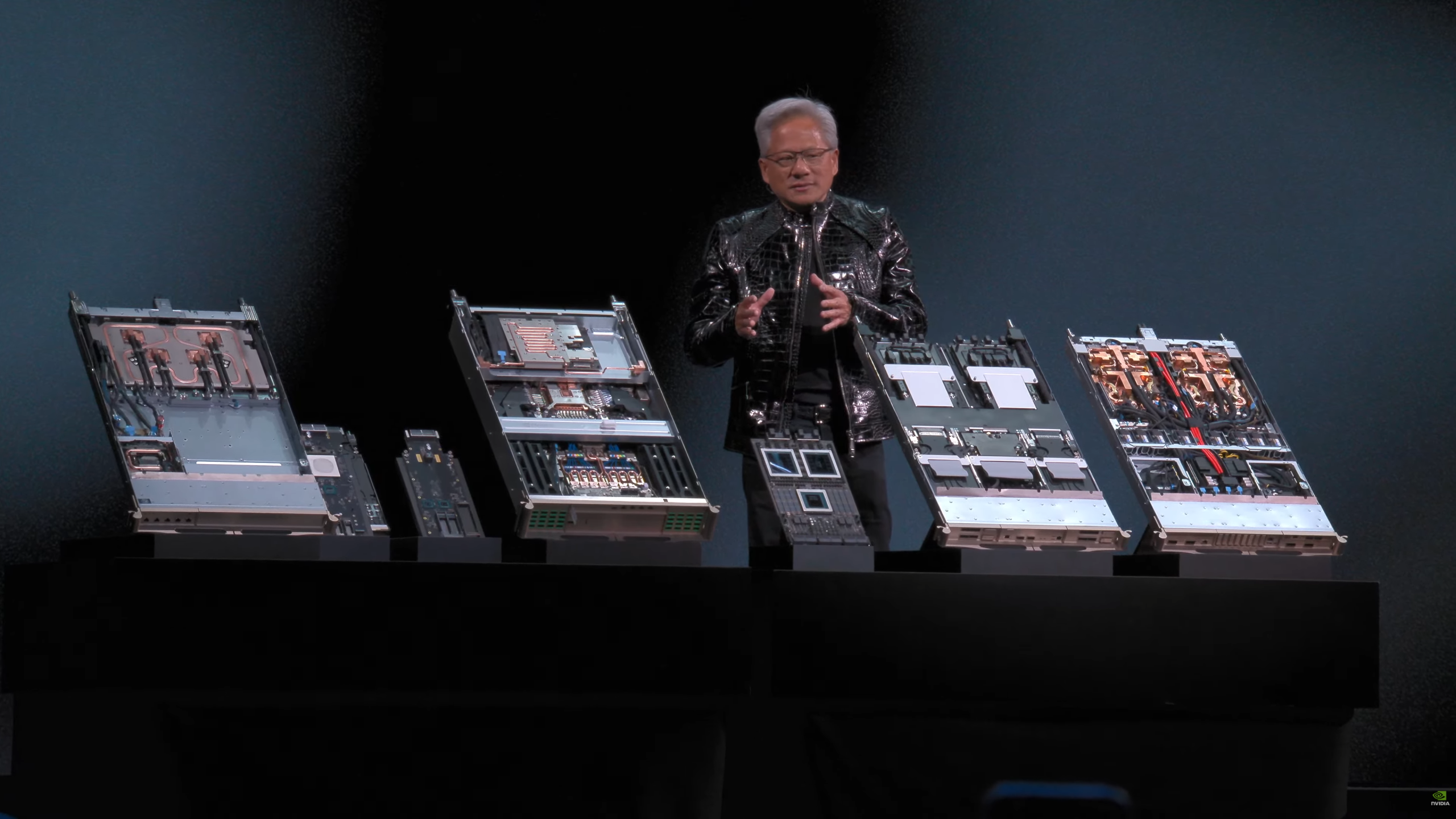

แพลตฟอร์ม AI ขนาดใหญ่ระดับ Rack

นอกจากการพัฒนาชิป NVIDIA ยังให้ความสำคัญกับการสร้างระบบคอมพิวต์ขนาดใหญ่สำหรับศูนย์ข้อมูล

หนึ่งในแพลตฟอร์มที่ได้รับความสนใจคือ Vera Rubin NVL72 ซึ่งเป็นระบบที่รวมชิป AI จำนวนมากไว้ใน rack เดียว

ระบบเหล่านี้ถูกออกแบบมาเพื่อรองรับงาน AI ระดับ hyperscale

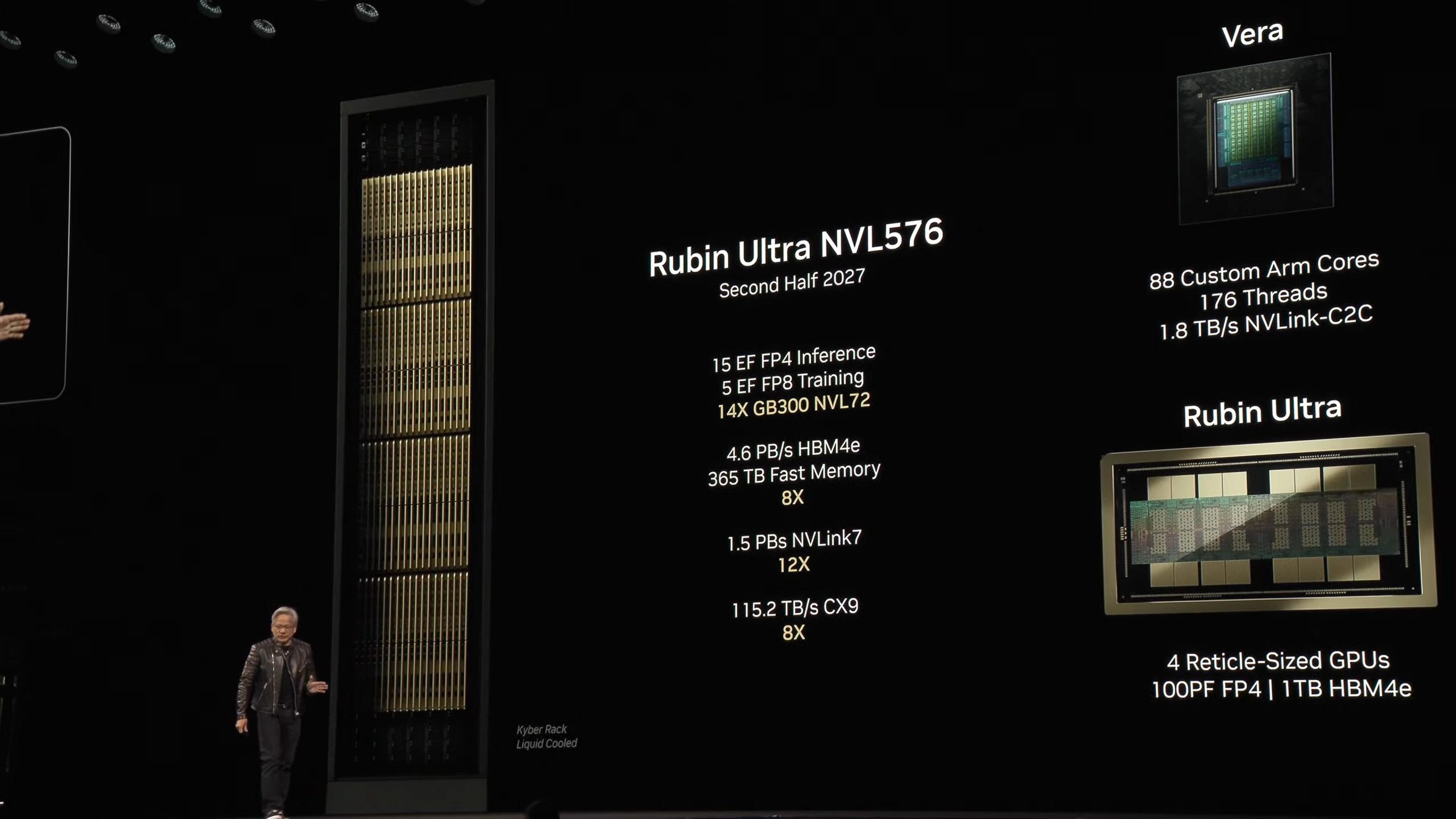

ในอนาคต NVIDIA อาจขยายระบบไปถึงระดับ

NVL144

NVL576

ระบบ NVL576 อาจเป็นหนึ่งในโครงสร้างคอมพิวต์ที่ใหญ่ที่สุด โดยใช้ GPU หลายร้อยตัวทำงานร่วมกัน

การเปลี่ยนแปลงด้านโครงสร้างศูนย์ข้อมูล

แพลตฟอร์ม AI รุ่นใหม่ไม่ได้เปลี่ยนแค่ชิป แต่ยังรวมถึงโครงสร้างของศูนย์ข้อมูลด้วย

ตัวอย่างการเปลี่ยนแปลงที่คาดว่าจะเกิดขึ้น เช่น

ระบบไฟฟ้าแบบ 800V DC สำหรับ rack

การใช้ optical interconnect แทนสายทองแดง

ระบบเครือข่ายแบบ Co-Packaged Optics

เทคโนโลยีเหล่านี้ช่วยแก้ปัญหา

ความร้อน

latency

throughput ของระบบ

ซึ่งเป็นปัญหาหลักของศูนย์ข้อมูล AI ขนาดใหญ่

แนวโน้มใหม่ของโครงสร้างคอมพิวต์ AI

สิ่งที่ชัดเจนจากข้อมูลทั้งหมดคือ NVIDIA กำลังเปลี่ยนแนวคิดจาก

GPU เป็นศูนย์กลางของระบบ

ไปสู่

แพลตฟอร์มคอมพิวต์แบบหลายชิป (heterogeneous computing)

ซึ่งประกอบด้วย

GPU

CPU

LPU

accelerator อื่น ๆ

แนวทางนี้ช่วยให้แต่ละชิปทำงานในส่วนที่ตนเองมีประสิทธิภาพสูงสุด

สิ่งที่อาจเห็นในงาน GTC ปีนี้

ในงาน NVIDIA GTC 2026 อาจมีการประกาศสำคัญหลายอย่าง เช่น

ระบบ Vera Rubin รุ่นใหม่

แพลตฟอร์ม rack-scale ขนาดใหญ่

รายละเอียดของสถาปัตยกรรม Feynman

ความร่วมมือกับ Groq

เทคโนโลยีเครือข่ายสำหรับศูนย์ข้อมูล

นอกจากนี้ยังมีข่าวลือว่า NVIDIA อาจมีการประกาศความร่วมมือกับผู้ผลิต CPU อย่าง Intel ด้วย

สรุป

งาน NVIDIA GTC 2026 อาจเป็นหนึ่งในเหตุการณ์สำคัญของอุตสาหกรรม AI เพราะมีแนวโน้มว่าบริษัทจะเริ่มเปลี่ยนแนวคิดจากการใช้ GPU เพียงอย่างเดียว ไปสู่แพลตฟอร์มคอมพิวต์แบบหลายสถาปัตยกรรม

การผสานเทคโนโลยีอย่าง GPU, LPU และระบบ rack-scale ขนาดใหญ่ อาจช่วยให้โครงสร้างพื้นฐาน AI สามารถรองรับงานประมวลผลรุ่นใหม่ที่ซับซ้อนมากขึ้น

หากแนวโน้มนี้เกิดขึ้นจริง งาน GTC ในปีนี้อาจเป็นจุดเริ่มต้นของยุคใหม่ในวงการ AI infrastructure

อ่านบทความอื่น ๆ เพิ่มเติมได้ที่ ZestBuy